Оглавление:

Информация по Шеннону

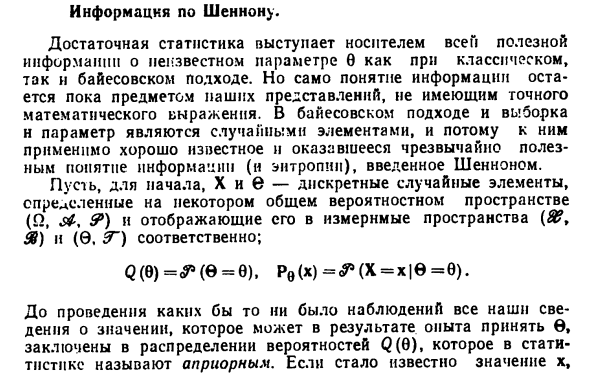

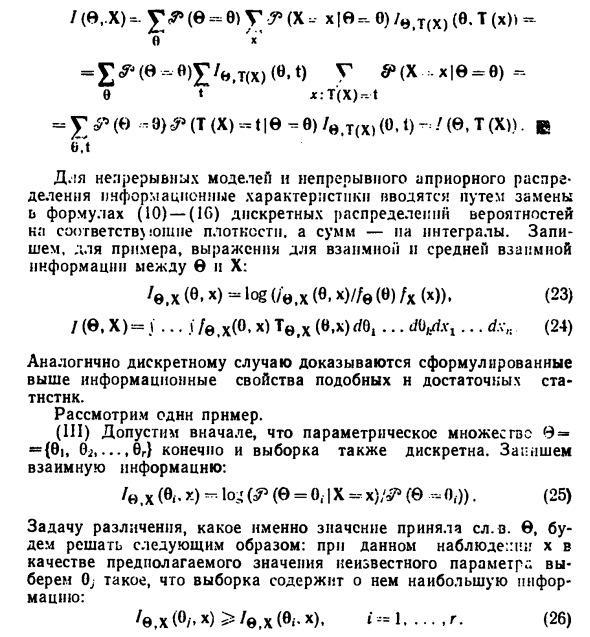

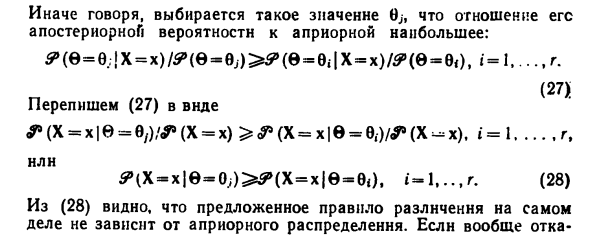

- Достаточно статистики все полезные карьеры Информация о неизвестном параметре 9 похожа на классику, И байесовский подход. Но концепция самой информации остается Является ли предмет наших идей точным Формула. Байесовский подход и выборка Поскольку параметр n является случайным элементом, Хорошо известно, очень полезно Полезна концепция информации (и энтропии), представленная Шенноном. Во-первых, пусть X и B будут дискретными случайными элементами, Определяется в нескольких общих вероятностных пространствах (Q, S4-, 9 *) и отображение в измеримое пространство (??, 38) и @, & ~) соответственно.

Прежде чем делать какие-либо наблюдения, Информация о ценности, которая может быть включена в результате опыта, Включено в распределение вероятностей QF). Тнстпкс называет априори. Как только значение х известно, Полное знание 9 попсов, полученное 172 случайной выборкой X Сожаления об условном распределении: В статистике это называется post hoc. Поэтому добавьте Дополнительная информация, включенная в эксперимент, изменена Неопределенность понимания для 9 возможных значений:

Перед экспериментом он, вероятно, был представлен априорным распределением. Людмила Фирмаль

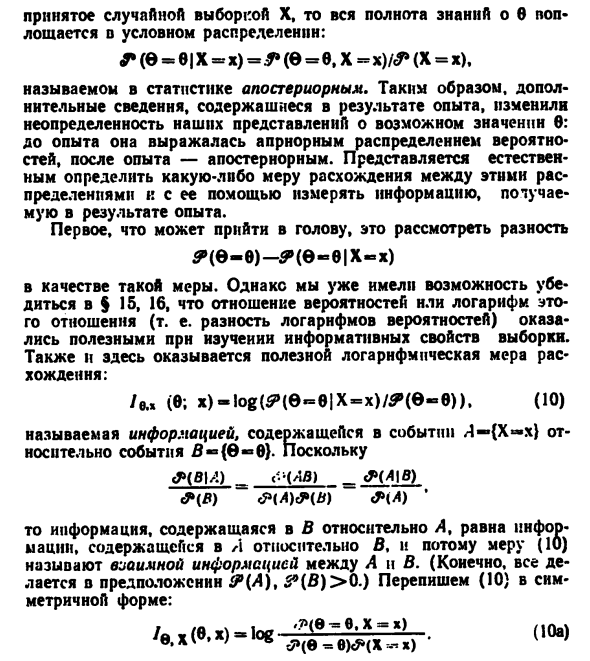

Вероятность, после опыта — после факта. естественно Естественно определить меру расхождения между этими Измерьте полученную информацию с помощью распределения k и его Получено в результате опыта. Первое, что может прийти в голову, это рассмотреть различия Как такое средство. Однако уже §15,16 с вероятностью или логарифмом Это соотношение (то есть логарифм вероятности) Это оказалось полезным при изучении полезных свойств образцов. Лог масштаб Дурак: в дюймах , (In; x) -iog (s ”(e. = E | x = x) / 0.) в предположении Симметричная форма: Подчеркните, что равенство информации не означает Эквивалентность выводов, которые можно сделать относительно A из знаний B, и Напротив, из знания А, пусть об А. B = тогда # (B | / 1) = 1.

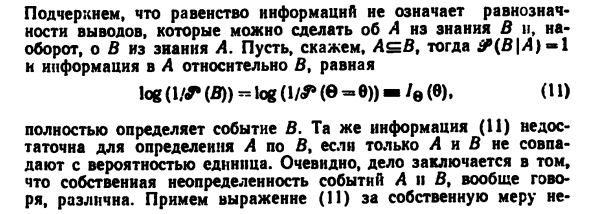

Информация для B равна n log A / G (B)) = log (UP (c «c)) — c (c), A1) Определить событие B полностью. Та же информация А1) Недостаточно определить A по B, если A и B не совпадают Соответствует вероятности 1. Очевидно, дело в том, Неопределенность, присущая событиям A и B, обычно Другая история Используйте формулу A1) в качестве уникальной меры не-A 173 Событие B уверенность, или ‘n ”» * 1, • »•• / ¦oL / ch.yaomiush информация Информация о себе включена в Событие Б. Может быть Толковать как совершенно необходимую информацию Устранить неопределенность в отношении события B.

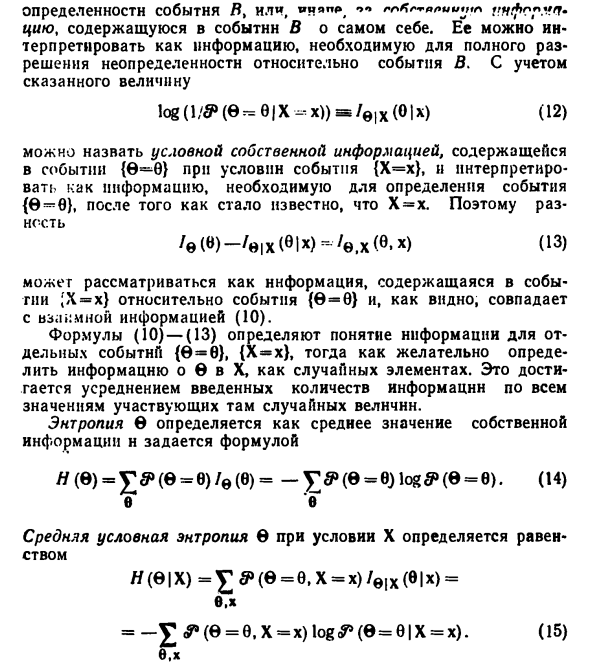

- Значение выше A2) Можно назвать содержащуюся условную уникальную информацию Событие {6 = 6} при условии события {X = x}, и Интерпретировать как информацию, необходимую для определения события {6 = 9}, после того, как выясняется, что X = x. Таким образом, разница Может рассматриваться как информация, включенная в мероприятие Событие, ‘X = x} для события {6 = 9}, соответствует, как вы можете видеть Взаимная информация А0). Определяет понятие информации в уравнениях A0) -A3) Отдельные события {6 = 9}, {X = x}, но должны быть определены Определяет информацию о X6 как случайный элемент. Это может быть достигнуто Достигается путем усреднения всей информации ввода

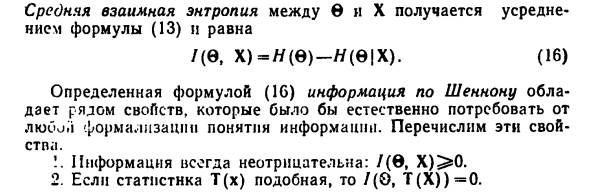

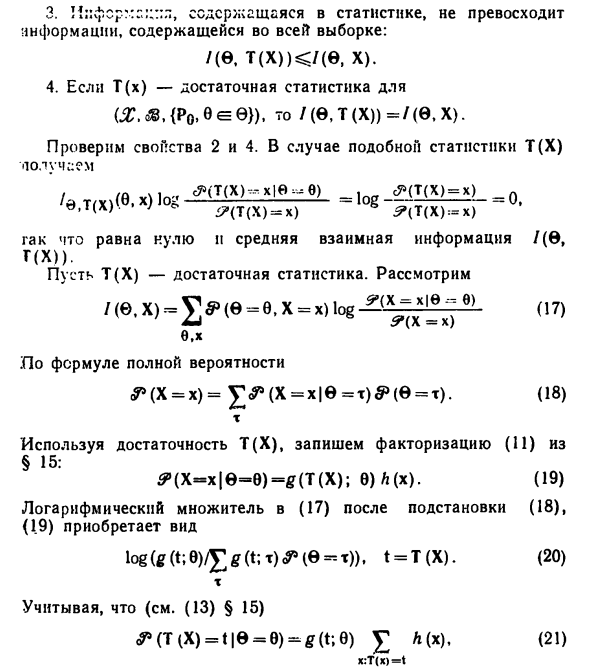

в Средняя условная энтропия 6 при условии Х равна равенство 6.x х). A5) хорошо Средняя взаимная энтропия между 6 и X усредняется Равно усреднению в уравнении A3) / @, X) = HF) -HF | X). A6) A6) Информация о Шенноне, определенная в Имеет много свойств, которые естественно требовать от люо.1 Формализация понятия информации. Перечислите эти Недвижимость. ! Информация не всегда отрицательна: / (c, X) ^ 0. 2. Если статистика T (x) аналогична, f (0, T (X)) = 0.

Значение случайной величины, содержащейся в нем. Энтропия 6 определяется как среднее из собственных значений Информация, задаваемая по формуле # (В) =] Г5> (е = 9) / в (9) = -y5> (9 = 9) log5> (9 = 9). A4) Людмила Фирмаль

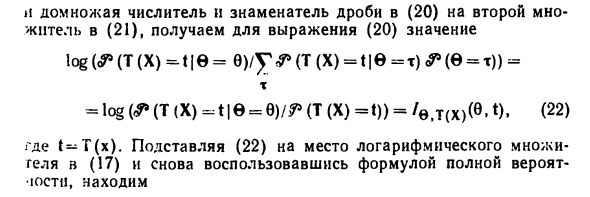

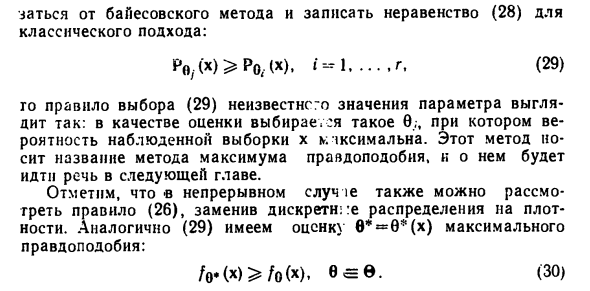

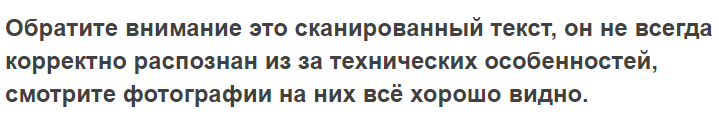

и :: fsr: -: g. :; :: l включен в статистику, Информация, включенная во весь образец: f (b, T (X)) ^ (b = e {| x = x) / ^ (b = e,), «= i r B7) B7) можно переписать как ^ (X = x | e = b /) / ^ (x = x) ^ <^ (x = x | b-e1) / P0. (X), i-lg, B9) Неизвестное правило выбора значения параметра B9) выглядит так: Это выглядит так: выберите 6 в качестве оценки. Наблюдаемый образец х имеет наибольшую вероятность. Этот метод Это называется методом максимального правдоподобия. Мы поговорим в следующей главе. Обратите внимание, что в непрерывном случае вы также можете рассмотреть следующее: Рассмотрим правило B6) и вычислим дискретное распределение Плотность. Как и в случае с B9, оценка максимума составляет * = 0 * (x) Возможности:

Смотрите также:

| Векторный параметр | Информация по Кульбаку |

| Полиномиальное распределение | Информация по Фишеру |

Если вам потребуется заказать статистику вы всегда можете написать мне в whatsapp.