Оглавление:

Что можно сделать в отношении автокорреляции?

- Что можно сделать с автокорреляцией? При определении ответа автокорреляция может быть устранена. Расширение одного или нескольких основных факторов и соответствующих им уравнений Феномен регрессии. Если это возможно, это может быть лучшим По решению. Пример приведен в упражнении 10.4. В других случаях принятая процедура зависит от Связь между случайными значениями терминов.

- Больше всего в литературе Первое внимание уделено первой так называемой авторегрессионной схеме. Однако, если наблюдения проводятся ежеквартально, или Другие модели могут быть лучше с каждым месяцем, Рассмотрим их здесь. Когда уравнение (7.21) является правильной спецификацией для измерения Случайная величина значения, тогда вы можете полностью устранить автокорреляцию.

Колонка (7.21), потому что это интуитивно считается, Используйте с более сложными моделями Но не достаточно. Людмила Фирмаль

Если бы вы знали значение р. Это показано в качестве примера. Уравнение регрессии только с одной объясняющей переменной od Однако тот же принцип применяется для больших чисел. Предполагая, что истинная модель определяется формулой (7.20), Наблюдение / и / -1 это yt = a + $ xt + ut- (7.23) A-i = «+ Px / -i + w, -i- (7,24) Теперь вычтите отношение, умноженное на p, с обеих сторон выражения (7.23)

Выражение (7.24) и получим: Yy-pYy-i = ot (l-p) + P (*, -p *, -i) + ut-puf_v (7.25) Указывает yt = yt -pyr- \, xt = xt -pxt_ {и qt = 1-p. Далее формула (7.25) имеет вид А как переписать Yy = «§ / + P * r + yi-Put — \ — (7.26) 222 В то же время из уравнения (7.21) имеем k, -pw, t = £. Таким образом, Формат мула (7.26) следующий: y, = aqt + $ xt + et. (7,27) Мы предположили, что р было известно.

Затем вы можете рассчитать величины yt, 5c и qt (Последнее одинаково для всех наблюдений.) 2 в G исходные данные. Теперь, если мы оценим регрессию между yt, xt и qt ( Не включайте константы в уравнение), то Оценивает a и p, но не имеет ничего общего с проблемами автокорреляции. По предположению, значения r не зависят друг от друга.

Однако небольшая проблема остается. Если образец не имеет данных, Идя к первому наблюдению, у {и хх и Первое наблюдение потеряно. Количество степеней свободы уменьшается на единицу, Это снижает эффективность, но это не может произойти для небольших образцов Чтобы сбалансировать повышение эффективности за счет устранения автокорреляции.

К счастью, этой проблемы можно легко избежать, используя: Называется исправление Прайс-Винстен (Prais and Winsten, 1954). Случайный член e, По определению, это не зависит от значения и Наблюдение. В частности, все величины 2 2, … не зависят от этого. Если все другие наблюдения преобразуются при удалении автокорреляции, После этого нет необходимости конвертировать первое наблюдение.

Может сохранить Предполагая, что y \ = y \, H \ = 1, x \ = xx, включите в новую схему. Таким образом, вы можете сохранить первое наблюдение, но очень мало Проблема, которая должна быть решена. Первое наблюдение, если р большое Оценка оказывает несоразмерное влияние на оценку. Числовое значение по уравнению регрессии.

Чтобы нейтрализовать этот эффект, уменьшите Умножьте это наблюдение на d / 1-p2, чтобы вычислить вес Y] = VI-p2ux, xi = d / 1-p2 xx и qx = v 1-p2. Причина выбора этого не Нормальный вес описан в Приложении 7.4. Конечно, значение p на самом деле неизвестно, и его оценочное значение равно 1 Временно в классах а и р. Есть несколько стандартных способов сделать это.

Вы можете повторно запустить оценку, и, возможно, один или несколько из этих методов. Анализируется с помощью регрессионного пакета. Метод Кокрана-Оркатта — это итеративный процесс, который включает в себя: Узнайте следующий шаг. 1. Расчетная регрессия с использованием исходных нетрансформированных данных (7.20) по 2. Остаток рассчитывается. 3.

Расчетная регрессионная зависимость et от et_v Представляет собой расчетное значение коэффициента {p уравнения (7.21), et. 4. При этой оценке p уравнение (7.20) преобразуется в (7.27) Это дает модифицированную оценку а и р. 5. Остаток пересчитывается и процесс возвращается к шагу 3. 223 Чередование коррекции оценочных значений а и р и оценки стадии р является.

- До достижения требуемой точности сходимости, то есть До последнего и последнего 1 цикла оценки соответствуют указанному Степень точности. Хильдрет — метод Лу. Широко используется в регрессионных пакетах, Основан на том же принципе, но с использованием разных алгоритмов расчета Колено, где регрессия (7,27) на р-значение Диапазон с конкретными шагами внутри.

Например, исследователи Вы можете указать диапазон от p = -1,00 до p = 1,00 в 0,01 единиц. ) дает минимальную стандартную ошибку пред При формировании уравнения Принимается в качестве оценки p, а коэффициент регрессии определяется, когда.

Используйте это значение для оценки уравнения (7.27). Людмила Фирмаль

Когда статистика Дурбина-Ватсона показывает очень близкие положительные значения Автокорреляция, вы можете применить простую процедуру, чтобы сделать выводы Предполагая, что p = 1, уравнение (7.25) принимает вид: yt-yt-x = P (*, — *, -i) + Щ-Щ-х- (7,28) То есть регрессионная зависимость разности значений оценивается у при непрерывном наблюдении разницы в значениях х.

Она известна как Первое разностное уравнение регрессии, часто записываемое как: Au, = \ bAx, + u, -i, _x. (7,29) Поскольку фактическое (неизвестное) значение р, вероятно, будет меньше 1 Хорошо, эта процедура, кажется, компенсирует некоторую автокорреляцию В избытке. Позже может показать теоретическую корреляцию.

Целочисленное значение (ut-ut_x) — (1-p) / 2. Закрыть р близко к единице, Поскольку эта корреляция мала, она, вероятно, улучшится Результат. Примеры использования метода первого различия можно найти в литературе. До конца 1970-х годов, но обычно не принято в современных исследованиях Я парализован.

До относительно недавнего времени его внутренняя простота привлекала внимание Вычислительный, но итеративный процесс благодаря развитию Менее мощные и быстрые компьютеры Поскольку время идет и становится дешевле, этот метод считается устаревшим Шим. способ MNC CO— PW доходов эластичность 0,637 0,651 A. 0026 0034

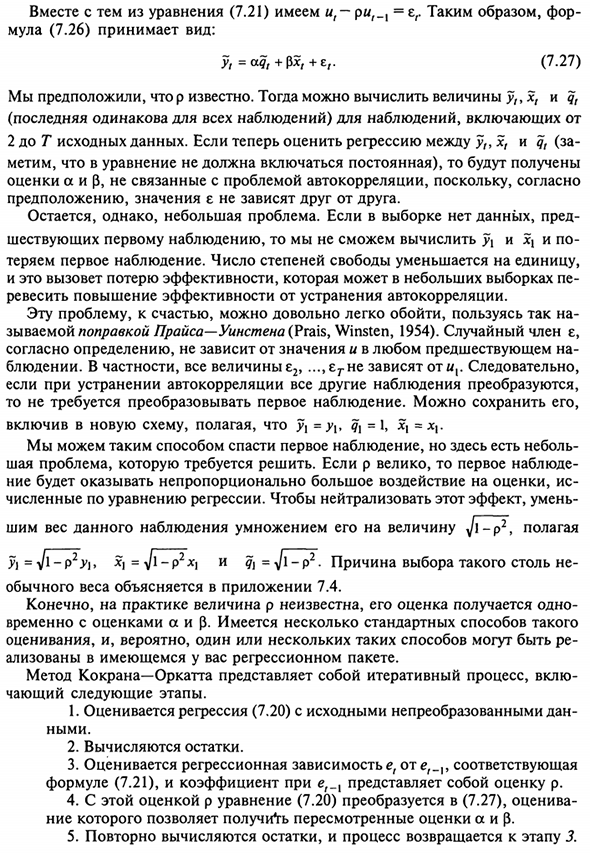

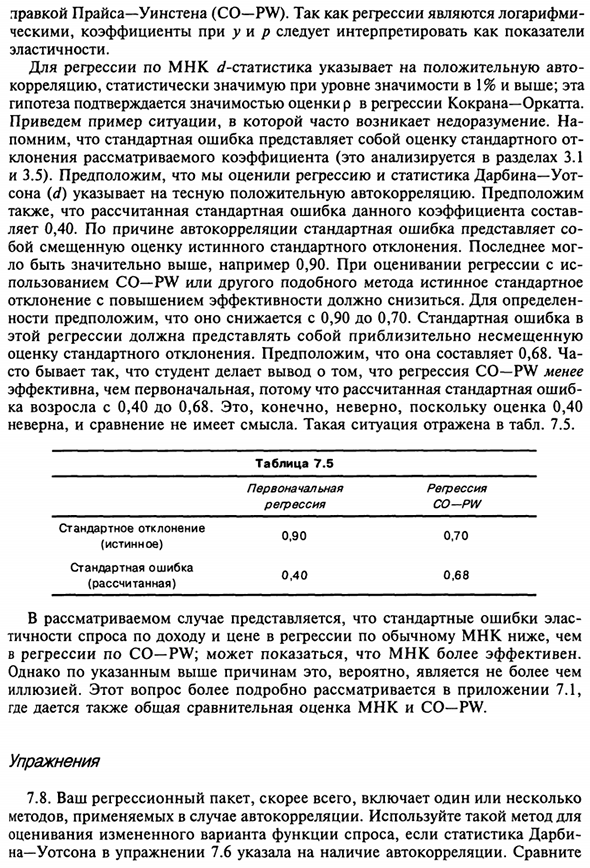

Таблица 7.4 цена эластичность -0,476 0,121 -0,578 0,130 L р 0,67 A. 0,1 6 d 0,63 1,74 / 7 2 0,987 0999 В таблице. 7.4 показывает результат построения логарифмической регрессии Стоимость еды (у), личный доход (х) и цена (р) Данные США (1959-1983 гг.) Приведены в таблице. Б.1 и Б.2;

Примечание Использовали обычный метод наименьших квадратов и метод Кокрейна-Отреза с коррекцией цены-Уинстена (CO-PW). Поскольку регрессия является логарифмической Физически коэффициенты y и p следует интерпретировать как показатели Эластичность.

Для регрессии OLS, J статистика показывает положительное авто Статистически значимая корреляция на уровне значимости 1% или выше. Это Гипотеза подтверждается значимостью оценочного значения p для регрессии Cochrane-O’Cut. Вот несколько примеров ситуаций, когда часто возникают недоразумения.

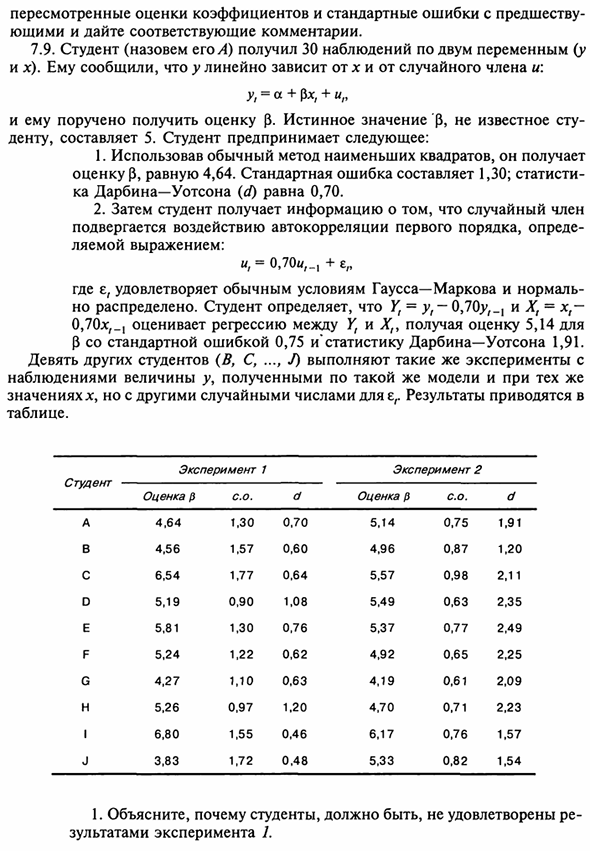

Помните, что стандартная ошибка является стандартной оценкой Отклонение рассматриваемого фактора (это анализируется в разделе 3.1 И 3.5). Предположим, вы оценили регрессию и статистику Дарбина-Вата. sone (d) указывает, что положительная автокорреляция близка. временно Также рассчитывается стандартная ошибка для конкретного коэффициента конфигурации Это 0,40.

Из-за автокорреляции стандартная ошибка Оценка истинного стандартного отклонения битвы. Последняя возможность Он должен быть значительно выше, например 0,90. При оценке регрессии с использованием Использование CO — PW или других подобных методов, настоящий стандарт Отклонения от повышения эффективности должны уменьшаться. предопределенный.

Фактически, предположим, что оно уменьшается с 0,90 до 0,70. Стандартная ошибка Эта регрессия должна быть почти справедливой Оценка стандартного отклонения. Предполагая 0,68. чай 100 раз студенты приходят к выводу, что отдача CO — PW меньше Более эффективен, чем оригинал, благодаря вычисленной стандартной ошибке Ка увеличилось с 0,40 до 0,68. Конечно, это не так.

Сравнение не имеет смысла, потому что это не правильно. Эта ситуация отражена в таблице. 7,5. Стандартное отклонение (True) Стандартная ошибка (Компьютерный) Таблица 7.5 первобытный регрессия 0,90 0,40 Рекурсия СО-PW 0,70 0,68 В этом случае стандартная ошибка elas Регулярность спроса на доходы и цены в обычной регрессии MNC Нерегрессивный СО — PW;

MNC может оказаться более эффективным. Однако по вышеуказанным причинам это, вероятно, Иллюзия. Этот вопрос подробно описан в Приложении 7.1. Общая сравнительная оценка OLS и CO — PW также показана. упражнения 7,8. В большинстве случаев регрессионный пакет содержит один или несколько Метод используется в случае автокорреляции.

Используйте этот метод Для статистики Derby оцените модифицированную версию функции спроса на Уотсоне в упражнении 7.6 показано существование автокорреляции. сравнить 225 Модифицированные оценки шансов и стандартные ошибки Дайте соответствующие комментарии 7.9.

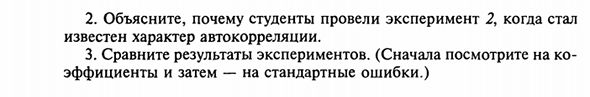

Студент (назовем А) имеет две переменные ( И х). Ему сообщили, что у линейно зависит от х и случайного члена: y, = a + px, + un И ему было поручено получить рейтинг p. Истинное значение неизвестного P Дент 5 лет. Студенты делают следующее: 1. Используя обычный метод наименьших квадратов, он P-оценка 4,64.

Стандартная ошибка 1,30. стат Isuti ka Darbin — Watson (d) составляет 0,70. 2. После этого студенты получат информацию о том, что они являются случайными членами С учетом определенной автокорреляции первого порядка Представлено: И = 0.70u, , + e „ Где E удовлетворяет нормальному условию Гаусса-Маркова и стандарту Тем не менее, он был распространен.

Студент, Yf = yf-0J0yt {и Xt = xt ~ 0,70x, _ оценивает регрессию между Yt и Xn и получает оценку 5,14 P — стандартная ошибка 0,75, * Darbin-1,91 статистика Ватсона. Другие девять учеников (B, C, …, J) Наблюдения y, полученные с той же моделью и той же моделью Значение L: Но используя другие случайные числа yy, результат.

Таблица 1 Объясните, почему студенты не должны быть довольны Эксперимент 1. 226 2. Объясните, почему студент вошел в Эксперимент 2 Природа автокорреляции известна. 3. Сравните результаты эксперимента. (Первый взгляд От факторинга к стандартной ошибке. )

Смотрите также:

Если вам потребуется помощь по эконометрике вы всегда можете написать мне в whatsapp.